مشكلة: بالنظر إلى العمليتين i وj، فأنت بحاجة إلى كتابة برنامج يمكنه ضمان الاستبعاد المتبادل بين الاثنين دون أي دعم إضافي للأجهزة.

هدر دورات ساعة وحدة المعالجة المركزية

بعبارات عامة، عندما كان الخيط ينتظر دوره، كان ينتهي بحلقة طويلة تختبر الحالة ملايين المرات في الثانية، مما يؤدي إلى إجراء عمليات حسابية غير ضرورية. هناك طريقة أفضل للانتظار وهي معروفة باسم 'أَثْمَر' .

لفهم ما يفعله، نحتاج إلى التعمق في كيفية عمل برنامج جدولة العمليات في Linux. الفكرة المذكورة هنا هي نسخة مبسطة من المجدول، التنفيذ الفعلي له الكثير من التعقيدات.

النظر في المثال التالي

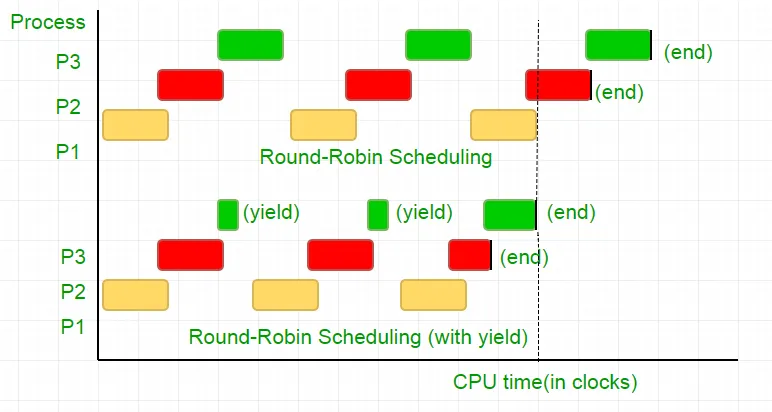

هناك ثلاث عمليات P1 P2 وP3. العملية P3 تحتوي على حلقة زمنية مشابهة لتلك الموجودة في الكود الخاص بنا والتي لا تقوم بعمليات حسابية مفيدة جدًا، وهي موجودة من الحلقة فقط عندما تنتهي P2 من تنفيذها. يضع المجدول كل منهم في قائمة انتظار مستديرة. لنفترض الآن أن سرعة ساعة المعالج هي 1000000/ثانية وأنه يخصص 100 ساعة لكل عملية في كل تكرار. ثم سيتم تشغيل P1 الأول لمدة 100 ساعة (0.0001 ثانية) ثم P2 (0.0001 ثانية) متبوعًا بـ P3 (0.0001 ثانية) الآن نظرًا لعدم وجود عمليات أخرى تتكرر هذه الدورة حتى تنتهي P2 ثم يتبعها تنفيذ P3 وفي النهاية إنهائها.

يعد هذا إهدارًا كاملاً لدورات ساعة وحدة المعالجة المركزية البالغ عددها 100 دورة. لتجنب ذلك، نتخلى بشكل متبادل عن شريحة وقت وحدة المعالجة المركزية، أي العائد الذي ينهي هذه الشريحة الزمنية بشكل أساسي ويقوم المجدول باختيار العملية التالية لتشغيلها. الآن نختبر حالتنا مرة واحدة ثم نتخلى عن وحدة المعالجة المركزية. وبالنظر إلى أن اختبارنا يستغرق 25 دورة على مدار الساعة، فإننا نوفر 75% من حساباتنا في شريحة زمنية. لوضع هذا بيانيا

وبالنظر إلى أن سرعة ساعة المعالج تبلغ 1 ميجاهرتز، فهذا يوفر الكثير!.

توفر التوزيعات المختلفة وظيفة مختلفة لتحقيق هذه الوظيفة. يوفر لينكس sched_yield() .

void lock(int self) { flag[self] = 1; turn = 1-self; while (flag[1-self] == 1 && turn == 1-self) // Only change is the addition of // sched_yield() call sched_yield(); }

سياج الذاكرة.

قد يكون الكود الموجود في البرنامج التعليمي السابق يعمل على معظم الأنظمة ولكنه لم يكن صحيحًا بنسبة 100%. كان المنطق مثاليًا ولكن معظم وحدات المعالجة المركزية الحديثة تستخدم تحسينات في الأداء يمكن أن تؤدي إلى تنفيذ خارج الترتيب. عادةً ما تمر إعادة ترتيب عمليات الذاكرة (التحميلات والتخزين) دون أن تتم ملاحظتها ضمن سلسلة تنفيذ واحدة، ولكنها يمكن أن تسبب سلوكًا غير متوقع في البرامج المتزامنة.

النظر في هذا المثال

while (f == 0); // Memory fence required here print x;

في المثال أعلاه، يعتبر المترجم الجملتين مستقلتين عن بعضهما البعض، وبالتالي يحاول زيادة كفاءة التعليمات البرمجية عن طريق إعادة ترتيبهما مما قد يؤدي إلى مشاكل للبرامج المتزامنة. لتجنب ذلك، قمنا بوضع حاجز للذاكرة لإعطاء تلميح للمترجم حول العلاقة المحتملة بين العبارات عبر الحاجز.

لذلك ترتيب البيانات

العلم[الذات] = 1؛

بدوره = 1-الذات؛

بينما (قم بتشغيل فحص الحالة)

أَثْمَر()؛

يجب أن يكون هو نفسه تمامًا حتى يعمل القفل وإلا فسينتهي به الأمر في حالة توقف تام.

للتأكد من أن المترجمين يقدمون تعليمات تمنع ترتيب البيانات عبر هذا الحاجز. في حالة دول مجلس التعاون الخليجي __sync_synchronize() .

لذلك يصبح الكود المعدل

التنفيذ الكامل في C:

// Filename: peterson_yieldlock_memoryfence.cpp // Use below command to compile: // g++ -pthread peterson_yieldlock_memoryfence.cpp -o peterson_yieldlock_memoryfence #include

// Filename: peterson_yieldlock_memoryfence.c // Use below command to compile: // gcc -pthread peterson_yieldlock_memoryfence.c -o peterson_yieldlock_memoryfence #include

import java.util.concurrent.atomic.AtomicInteger; public class PetersonYieldLockMemoryFence { static AtomicInteger[] flag = new AtomicInteger[2]; static AtomicInteger turn = new AtomicInteger(); static final int MAX = 1000000000; static int ans = 0; static void lockInit() { flag[0] = new AtomicInteger(); flag[1] = new AtomicInteger(); flag[0].set(0); flag[1].set(0); turn.set(0); } static void lock(int self) { flag[self].set(1); turn.set(1 - self); // Memory fence to prevent the reordering of instructions beyond this barrier. // In Java volatile variables provide this guarantee implicitly. // No direct equivalent to atomic_thread_fence is needed. while (flag[1 - self].get() == 1 && turn.get() == 1 - self) Thread.yield(); } static void unlock(int self) { flag[self].set(0); } static void func(int s) { int i = 0; int self = s; System.out.println('Thread Entered: ' + self); lock(self); // Critical section (Only one thread can enter here at a time) for (i = 0; i < MAX; i++) ans++; unlock(self); } public static void main(String[] args) { // Initialize the lock lockInit(); // Create two threads (both run func) Thread t1 = new Thread(() -> func(0)); Thread t2 = new Thread(() -> func(1)); // Start the threads t1.start(); t2.start(); try { // Wait for the threads to end. t1.join(); t2.join(); } catch (InterruptedException e) { e.printStackTrace(); } System.out.println('Actual Count: ' + ans + ' | Expected Count: ' + MAX * 2); } }

import threading flag = [0 0] turn = 0 MAX = 10**9 ans = 0 def lock_init(): # This function initializes the lock by resetting the flags and turn. global flag turn flag = [0 0] turn = 0 def lock(self): # This function is executed before entering the critical section. It sets the flag for the current thread and gives the turn to the other thread. global flag turn flag[self] = 1 turn = 1 - self while flag[1-self] == 1 and turn == 1-self: pass def unlock(self): # This function is executed after leaving the critical section. It resets the flag for the current thread. global flag flag[self] = 0 def func(s): # This function is executed by each thread. It locks the critical section increments the shared variable and then unlocks the critical section. global ans self = s print(f'Thread Entered: {self}') lock(self) for _ in range(MAX): ans += 1 unlock(self) def main(): # This is the main function where the threads are created and started. lock_init() t1 = threading.Thread(target=func args=(0)) t2 = threading.Thread(target=func args=(1)) t1.start() t2.start() t1.join() t2.join() print(f'Actual Count: {ans} | Expected Count: {MAX*2}') if __name__ == '__main__': main()

class PetersonYieldLockMemoryFence { static flag = [0 0]; static turn = 0; static MAX = 1000000000; static ans = 0; // Function to acquire the lock static async lock(self) { PetersonYieldLockMemoryFence.flag[self] = 1; PetersonYieldLockMemoryFence.turn = 1 - self; // Asynchronous loop with a small delay to yield while (PetersonYieldLockMemoryFence.flag[1 - self] == 1 && PetersonYieldLockMemoryFence.turn == 1 - self) { await new Promise(resolve => setTimeout(resolve 0)); } } // Function to release the lock static unlock(self) { PetersonYieldLockMemoryFence.flag[self] = 0; } // Function representing the critical section static func(s) { let i = 0; let self = s; console.log('Thread Entered: ' + self); // Lock the critical section PetersonYieldLockMemoryFence.lock(self).then(() => { // Critical section (Only one thread can enter here at a time) for (i = 0; i < PetersonYieldLockMemoryFence.MAX; i++) { PetersonYieldLockMemoryFence.ans++; } // Release the lock PetersonYieldLockMemoryFence.unlock(self); }); } // Main function static main() { // Create two threads (both run func) const t1 = new Thread(() => PetersonYieldLockMemoryFence.func(0)); const t2 = new Thread(() => PetersonYieldLockMemoryFence.func(1)); // Start the threads t1.start(); t2.start(); // Wait for the threads to end. setTimeout(() => { console.log('Actual Count: ' + PetersonYieldLockMemoryFence.ans + ' | Expected Count: ' + PetersonYieldLockMemoryFence.MAX * 2); } 1000); // Delay for a while to ensure threads finish } } // Define a simple Thread class for simulation class Thread { constructor(func) { this.func = func; } start() { this.func(); } } // Run the main function PetersonYieldLockMemoryFence.main();

// mythread.h (A wrapper header file with assert statements) #ifndef __MYTHREADS_h__ #define __MYTHREADS_h__ #include

// mythread.h (A wrapper header file with assert // statements) #ifndef __MYTHREADS_h__ #define __MYTHREADS_h__ #include

import threading import ctypes # Function to lock a thread lock def Thread_lock(lock): lock.acquire() # Acquire the lock # No need for assert in Python acquire will raise an exception if it fails # Function to unlock a thread lock def Thread_unlock(lock): lock.release() # Release the lock # No need for assert in Python release will raise an exception if it fails # Function to create a thread def Thread_create(target args=()): thread = threading.Thread(target=target args=args) thread.start() # Start the thread # No need for assert in Python thread.start() will raise an exception if it fails # Function to join a thread def Thread_join(thread): thread.join() # Wait for the thread to finish # No need for assert in Python thread.join() will raise an exception if it fails

الإخراج:

Thread Entered: 1

Thread Entered: 0

Actual Count: 2000000000 | Expected Count: 2000000000